De onmisbare rol van Explainable AI (XAI): vertrouwen bouwen in de AI-revolutie

Er is een oud Nederlands gezegde: "Vertrouwen komt te voet en gaat te paard." Deze wijsheid is niet alleen van toepassing op menselijke relaties, maar wordt steeds relevanter in onze omgang met technologie. Nu AI-systemen een steeds grotere rol spelen bij belangrijke beslissingen – van kredietaanvragen tot medische diagnoses – wordt het begrijpen van deze technologie niet langer een luxe, maar een noodzaak.

Waarom transparantie in AI onmisbaar is geworden

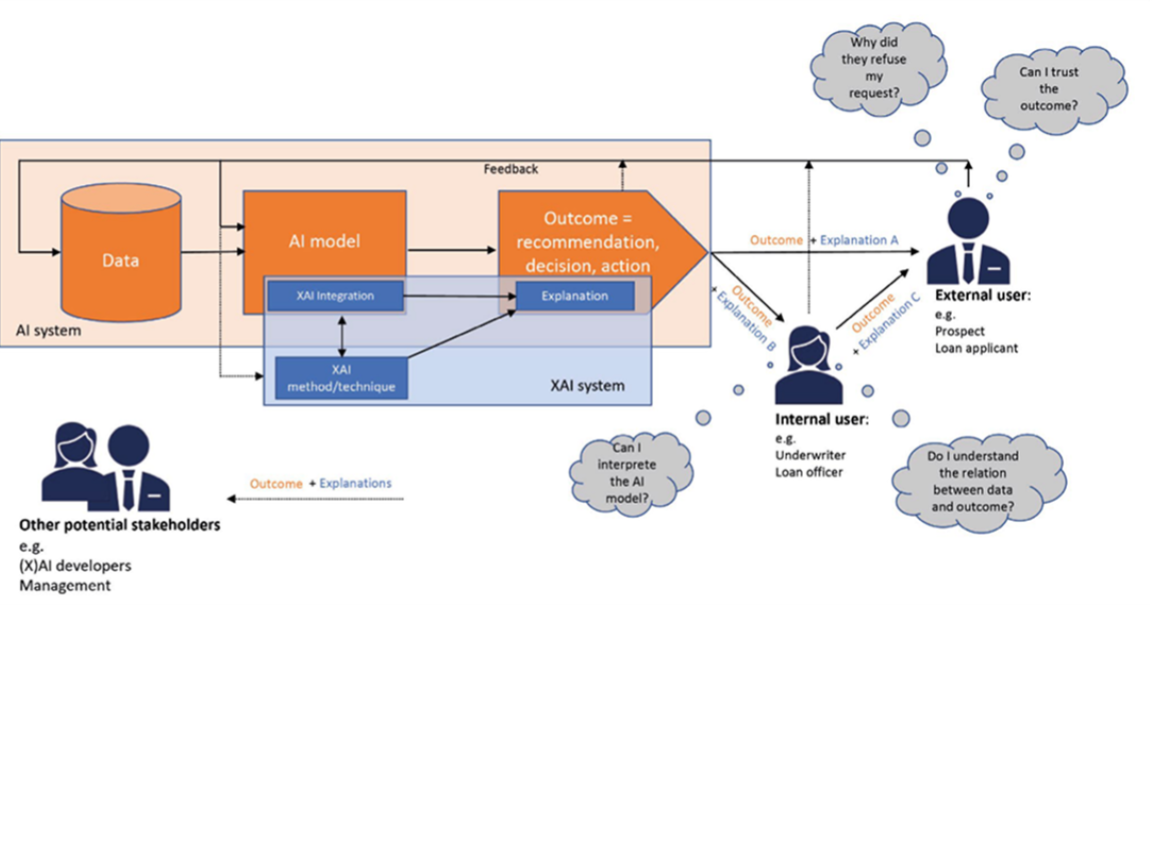

AI-systemen nemen steeds vaker beslissingen die directe impact hebben op ons dagelijks leven. Denk aan het goedkeuren van een hypotheek, het detecteren van fraude in financiële transacties of zelfs het stellen van een medische diagnose. Maar wat gebeurt er als deze systemen een beslissing nemen die we niet begrijpen? Of erger nog, een beslissing die mogelijk bevooroordeeld of incorrect is? Hier komt Explainable AI (XAI) om de hoek kijken. XAI is geen modieuze term of voorbijgaande trend – het is de sleutel tot verantwoord innoveren in een wereld die steeds afhankelijker wordt van kunstmatige intelligentie.

Van black box naar glazen huis: de uitdaging van moderne AI

Moderne AI-modellen, vooral deep learning systemen, staan bekend om hun complexiteit. Deze zogenaamde 'black boxes' kunnen indrukwekkende resultaten leveren, maar het proces achter hun besluitvorming blijft vaak ondoorzichtig

Dit gebrek aan transparantie kan leiden tot:

- •Wantrouwen bij eindgebruikers die beslissingen niet kunnen verifiëren

- •Compliance-problemen met nieuwe regelgeving zoals de AI Act

- •Beperkte mogelijkheden voor professionals om fouten te detecteren en corrigeren

- •Gemiste kansen om modellen verder te verbeteren op basis van inzichten

Een praktische benadering: de XAI-checklist voor de financiële sector

Bij Researchable hebben we enkele jaren geleden het voortouw genomen in het aanpakken van deze uitdaging. In samenwerking met de Hogeschool Utrecht, Floryn en De Volksbank, en met ondersteuning van de Taskforce for Applied Research SIA, ontwikkelden we een uitgebreide whitepaper over XAI specifiek voor de financiële sector. Het resultaat? Een praktische checklist die ontwikkelaars en data scientists helpt om uitlegbaarheid in elke fase van het AI-proces te integreren:

1. Organisatieniveau

Hier liggen richtlijnen voor de algemene XAI-filosofie en governance binnen de organisatie. Belangrijke controlepunten zijn onder andere:

- •Vastleggen van waarden en principes rondom XAI en explainability

- •Ontwikkelen van processen voor ontwerp, ontwikkeling, beoordeling en monitoring van XAI-systemen

- •In kaart brengen van relevante wetten en regelgeving voor transparantie en uitleg

2. Use case-niveau

Dit niveau zoomt in op de concrete toepassing van XAI per projectfase:

- •Business & Understanding Data: Bepalen van de gewenste transparantie- en uitlegniveaus, risico’s en doelstellingen van het AI-model

- •Model Development: Kiezen van het type AI-model, de datakwaliteit en de XAI-strategie (intern of post-hoc), en vastleggen welke stakeholder welke uitleg nodig heeft

- •Model Operations: Inrichten van de uitlevering van verklaringen (format, timing, interactiviteit) en evalueren van XAI-methoden en de tevredenheid van gebruikers

Elk controlepunt is gekoppeld aan een verantwoordelijke en een eindverantwoordelijke rol, en aan de relevante fase in de AI-lifecycle

3. Monitoring en onderhoudsfase

Uitlegbaarheid is geen eenmalige actie, maar een continu proces. We monitoren of de uitleg nog steeds klopt als het model zich ontwikkelt en de data verandert.

Uitlegbaarheid op maat: verschillende stakeholders, verschillende behoeften

Een van de belangrijkste inzichten uit ons onderzoek is dat niet iedereen dezelfde uitleg nodig heeft. De checklist helpt organisaties om verschillende vormen van uitleg te ontwikkelen voor verschillende doelgroepen:

- •Voor klanten: Eenvoudige, begrijpelijke verklaringen over factoren die hun persoonlijke uitkomst hebben beïnvloed

- •Voor medewerkers: Diepere inzichten die hen helpen beslissingen uit te leggen en eventueel bij te sturen

- •Voor toezichthouders: Gedetailleerde technische documentatie die aantoont dat het systeem voldoet aan regelgeving en ethische standaarden

- •Voor ontwikkelaars: Technische uitlegbaarheid die helpt bij het debuggen en verbeteren van modellen

Voorbij de financiële sector: universele principes voor XAI

Hoewel de whitepaper zich richt op financiële toepassingen, zijn de principes breed inzetbaar. Of het nu gaat om gezondheidszorg, personeelsselectie of energiebeheer, elke sector waar AI beslissingen ondersteunt, kan profiteren van een gestructureerde aanpak voor uitlegbaarheid.

De kernprincipes blijven hetzelfde:

- •Transparantie is geen vinkje maar een proces: Uitlegbaarheid moet in elke fase van het AI-project worden overwogen en geïmplementeerd

- •Context is koning: De uitleg moet worden afgestemd op de specifieke gebruiker en situatie

- •Balans tussen complexiteit en bruikbaarheid: Een perfecte technische uitleg die niemand begrijpt heeft weinig waarde

De toekomst van XAI: waar technologie en menselijk begrip samenkomen

De echte uitdaging in XAI zit niet alleen in de technologie, maar in het vertalen van complexe modeluitleg naar begrijpelijke inzichten. Dit vereist een multidisciplinaire aanpak waarin data scientists, domeinexperts, ontwerpers en eindgebruikers samenwerken. Bij Researchable geloven we dat deze brug tussen technologie en menselijk begrip de sleutel is tot verantwoorde AI-innovatie. Door transparantie en uitlegbaarheid centraal te stellen, bouwen we niet alleen betere AI-systemen, maar ook het vertrouwen dat nodig is om deze technologie succesvol te implementeren.

Begin vandaag nog met uitlegbare AI

Ben je benieuwd hoe jouw organisatie kan profiteren van een meer transparante en uitlegbare benadering van AI? De volledige whitepaper "A Checklist for Explainable AI in the Financial Sector" biedt concrete handvatten om hiermee aan de slag te gaan.

Download hier de whitepaper en zet de eerste stappen naar AI die niet alleen krachtig is, maar ook begrijpelijk en vertrouwenswaardig.

Wil je meer weten over hoe Researchable jouw organisatie kan ondersteunen bij het implementeren van uitlegbare AI? Neem dan contact met ons op voor een vrijblijvend gesprek.

Wil je meer weten over onze expertise en projecten op het gebied van AI? Bekijk dan ook onze andere blogposts over data science, machine learning en verantwoorde AI-implementatie.